Guten Morgen,

momentan arbeite ich an einem kleinen Webprojekt und wollte Fragen, ob ich das dann hier (genaugenommen dann unter 'Projekte und Showcase') teilen darf.

Ursprünglich wollte ich das hier unter 'Projekte und Showcase' packen, hatte allerdings die Beiträge ein wenig überflogen und musste feststellen, dass die dort vorgestellten Projekte bereits vorzeigbar bzw. nutzbar waren. Da ich mir dadurch etwas unsicher war, wollte ich das lieber hier vorstellen, wo ich mit einem fehlerhaft platzierten Beitrag wahrscheinlich noch den kleinsten Schaden anrichten könnte.

Kurzzusammenfassung:

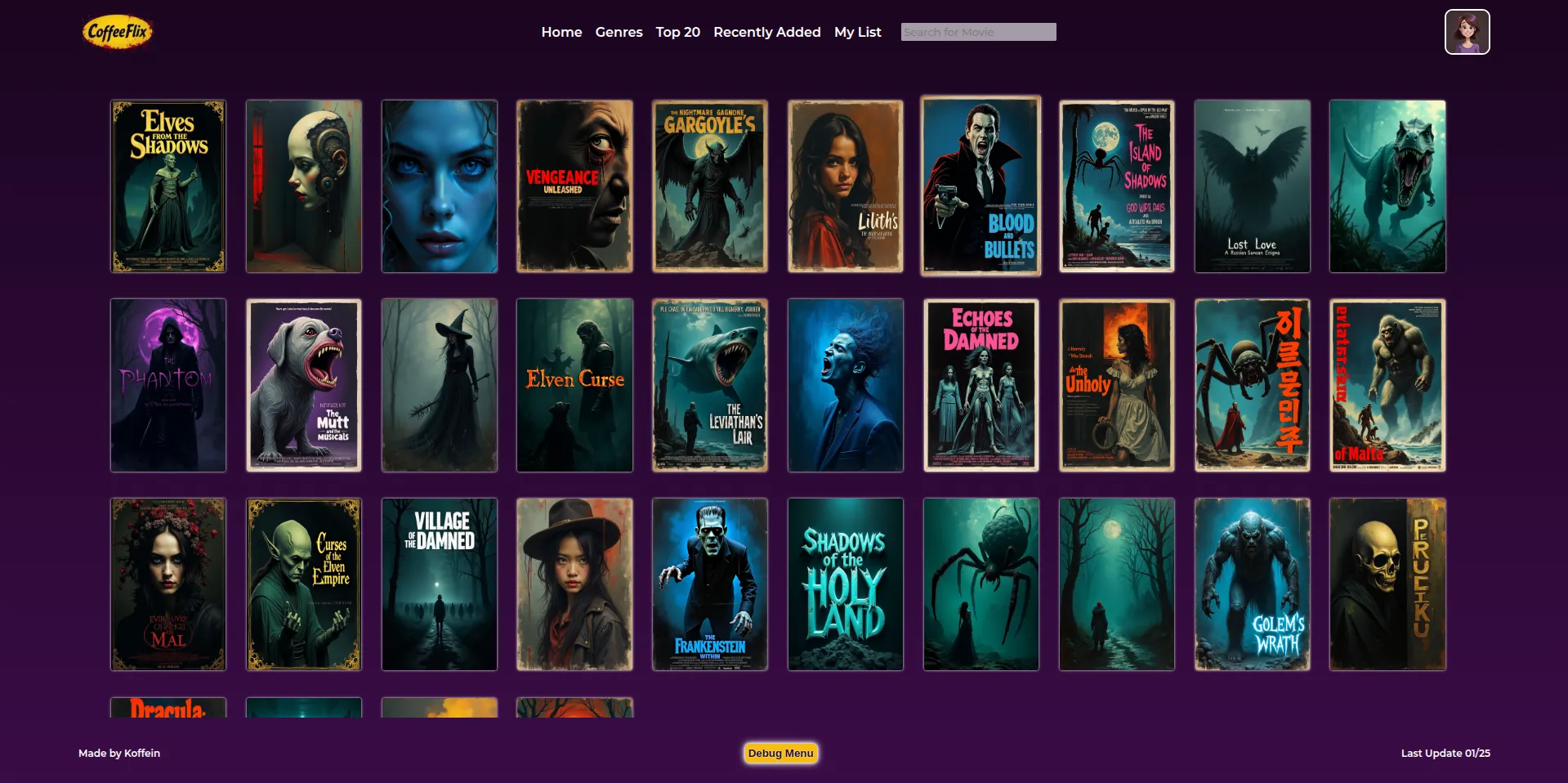

Bei dem Projekt handelt es sich genaugenommen um ein Webprojekt, bei dem ich das Frontend eines Streaming-Services bastle (angelehnt an Netflix, Prime und Co.). Die dort enthaltenen Filme wären aber allesamt fiktiv. Wie auch bei den Frontends der Inspirationsquellen, wird es dann Cards mit den jeweiligen Film-Postern als Bild geben. Mit einem Klick auf die jeweilige Card gelangt man dann eben zu der Film-Seite selbst, die Namen, Beschreibung, Ursprungsländer, Beteiligte usw. enthält. Sämtliche die Filme betreffenden Inhalte würden zufällig über ein Python Skript oder im Falle der Bilder und Beschreibungen eben von KI (FLUX (evtl. SDXL für Schauspieler Portraits) für die Bilder und Mistral-7b für Beschreibungen) generiert werden. Die Datenbank (stand jetzt: lediglich zwei JSON-Dateien, die über Python ausgelesen werden) würde dann eben sämtliche Inhalte zu den jeweiligen fiktiven Filmen und Schauspielern enthalten, womit auch Suchen möglich wären. Außerdem soll es auch eine Schauspieler-Datenbank geben, in der diese dann auch alle in Form von Cards anklickbar wären, mit Infos wie den Filmen, in denen sie mitgespielt haben, Geburtsdatum und auch einer kleinen Beschreibung, die ebenfalls per KI-Generiert wäre. Ansehen kann man dann selbstverständlich keinen der Filme. Allerdings dachte ich mir, dass ich im späteren Verlauf dann auch einen kleinen Videoplayer basteln könnte, der beim Starten eines Filmes einfach eine Ladeanimation zeigt und nach einer Weile eine Fehlermeldung ala "Der abgerufene Film kann leider nicht gestartet werden (Fehlercode: xxxxx)" anzeigt. Das würde die Illusion ein wenig aufrecht erhalten.

Hosten würde ich die Seite dann wahrscheinlich nirgends, das Projekt aber dann auf Github anbieten, mitsamt Installationsanleitungen für Linux und Windows. Wer dann über die nötige Hardware verfügt, könnte dann eben zusätzlich neue Filme lokal generieren. Dies dann komplett zufallsbasiert oder aber mit eigenen Eingaben, was Genre, Titel, Mitwirkende und Co. angeht.

Genutzte Technologien:

- Python mit FastAPI und Uvicorn (Backend)

- VueJS (Frontend )

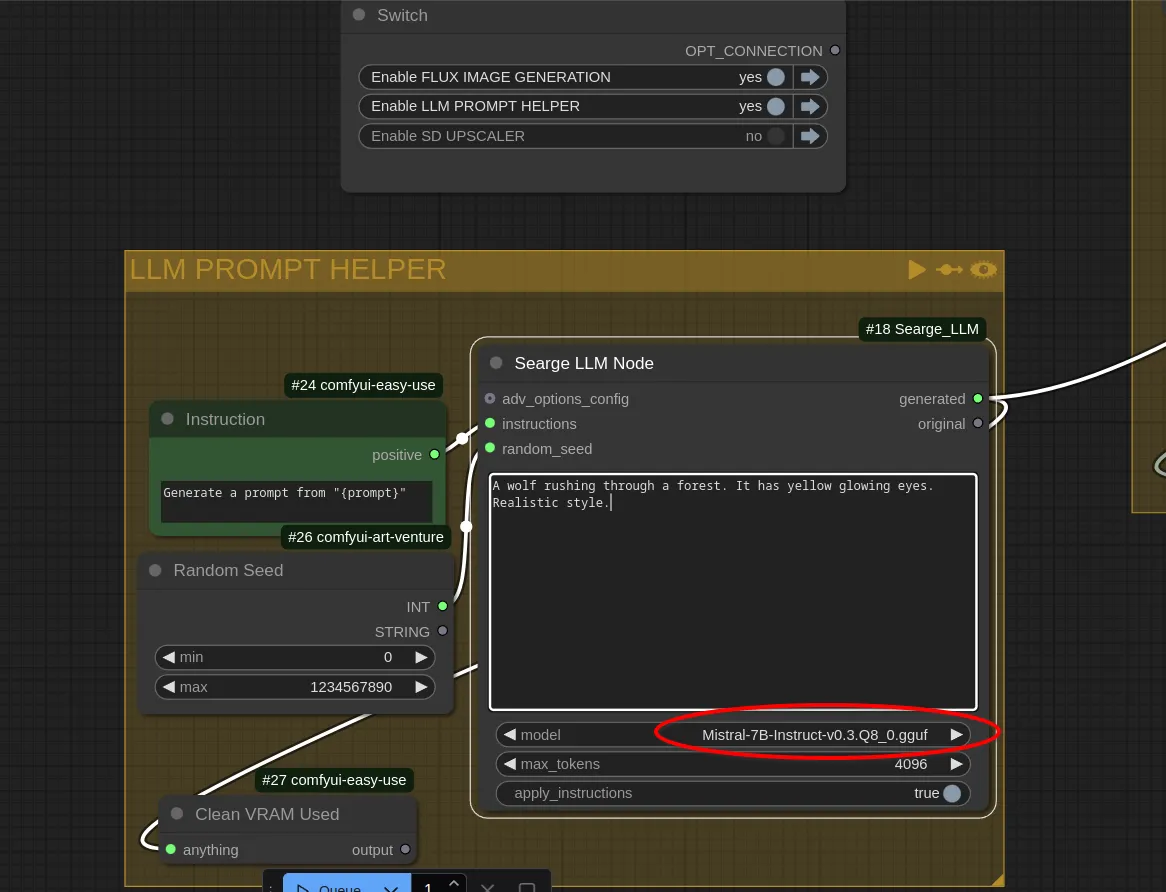

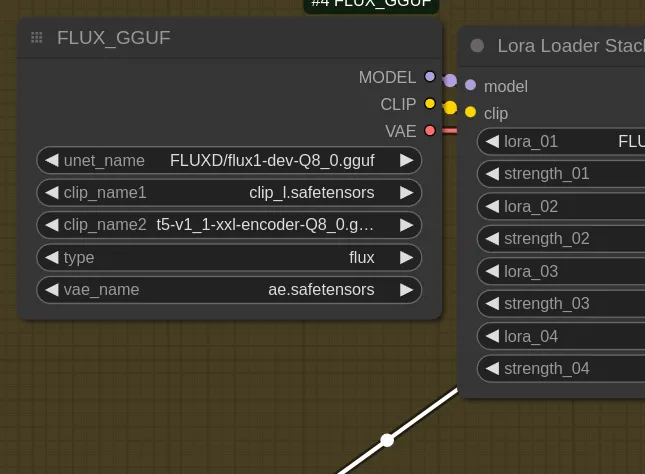

- ComfyUI mit selbst gebastelten Workflows (zur Verwendung der KI-Modelle - verfügbar auf Github)

- Flux1.dev GGUF (Bildgenerierung - verfügbar auf Huggingface)

- Mistral-7b (Textgenerierung - verfügbar auf Huggingface)

- Eine selbst trainierte LoRa (Zur Verbesserung der Ergebnisse beim Generieren der Film-Poster - dann verfügbar auf Huggingface)

Momentaner Status:

Die ComfyUI-Workflows sind schon fertig und das Generieren neuer Film-Einträge, der Beschreibungstexte und Film-Poster via API-Anfrage funktioniert bereits. Die dadurch erzeugten Bilder werden dann auch schon im richtigen Pfad mit der Film-ID im Namen abgespeichert und die Beschreibung und anderen Informationen in die Datenbank aufgenommen. Mit dem Frontend selbst habe ich auch bereits begonnen. Allerdings wollte ich mich vorerst auf das Trainieren einer LoRa konzentrieren. Mit den Ergebnissen von Flux (Standard und ohne LoRa) bin ich nicht besonders zufrieden. Hier finden sich nämlich häufig massenhaft Hieroglyphen-Texte im unteren oder oberen Bereich des Film-Posters, die wohl die Erwähnung der Mitwirkenden und Studios imitieren sollen, wie man sie häufig auf Werbe-Postern von Filmen findet. Das möchte ich aber nicht auf den Postern haben. Man sieht es bei den Cards auf Netflix und Co. schließlich auch nicht.

Nutzen und Gründe:

Einen Zweck hat das genaugenommen keinen. Ich sehe das eher als eine Art Kunstprojekt. Hiermit möchte ich mich dann eher kreativ ein wenig austoben und an meinen Fähigkeiten feilen.

Der Grund, warum ich das hier poste, hängt genaugenommen damit zusammen, dass ich (wie bereits in meiner Vorstellung erwähnt), ein wenig Probleme damit habe, bei einer Sache zu bleiben. Ich erhoffe mir durch das Teilen des Projektes, dass das so einen sanften Druck auf mich ausübt und ich dadurch dann eben dabei bleibe, statt im Affekt dann wieder etwas neues zu beginnen. Ob hier nun irgendwer auch nur die geringste Spur an Interesse ausdrückt, wird dabei keinen großen Unterschied machen. Hiermit habe ich es nämlich in die Welt gerufen und muss nun damit leben, dass das hier zu jeder Zeit jemand lesen könnte.

Das wäre es dann soweit. ![]()